Capítulo 15 Métodos de computación intensiva: El Bootstrap

15.1 Introducción: Precisión de un estimador

Los métodos bootstrap que se expondrán a continuación son un conjunto de técnicas introducidas por Bradley Efron de la universidad de Stanford a finales de los años 70 ([7,9,12]) que se han revelado como una poderosa herramienta de gran utilidad en diversos campos de la estadística.

15.1.1 Ejemplos de introducción

Empezaremos por considerar algunas situaciones aparentemente sencillas en donde se nos presentarán algunos problemas difíciles de resolver mediante las técnicas “clásicas” de la inferencia estadística (convendremos en denominar así al conjunto de métodos paramétricos y no paramétricos que constituyen el soporte usual de la inferencia estadística).

15.1.1.1 Problema 1: Tiempo de supervivencia

Supongamos que estamos interesados en estudiar el tiempo de vida, en años, de unos enfermos después de un trasplante de riñón. El parámetro que nos interesa estimar es el tiempo medio de vida tras la intervención. Para estimarlo podemos utilizar la media muestral, \(\bar{X}\) o la mediana muestral \(\widehat{\operatorname{Med}}(X)\). Los datos de que disponemos \((n=9)\) son los siguientes:

Tabla 1 Tiempos de supervivencia

| t1 | t2 | t3 | t4 | t5 |

|---|---|---|---|---|

| 0.14 | 0.18 | 0.25 | 0.26 | 0.37 |

| 0.43 | 0.51 | 0.61 | 0.71 |

El valor de los estimadores seleccionados, calculados sobre la muestra es:

- Media muestral, \(\bar{X}=0,384\),

- Mediana muestral, \(\widehat{\operatorname{Med}}(X)=0,37\)

15.1.1.2 Problema 2: Coeficiente de correlación

Disponemos de las notas de C.O.U. y de selectividad de un grupo de 15 alumnos de primer curso de la universidad y deseamos determinar cuán relacionadas se hallan las dos. Puesto que se trata de medidas numéricas podemos medir el grado de relación entre ambas mediante el coeficiente de correlación de Pearson: \(\hat{\rho}=\frac{\sum_{i=1}^{n}\left(X_{i}-\bar{X}\right)\left(Y_{i}-\bar{Y}\right)}{\sqrt{\sum_{i=1}^{n}\left(X_{i}-\bar{X}\right)^{2}} \sqrt{\sum_{i=1}^{n}\left(Y_{i}-\bar{Y}\right)^{2}}}, \quad\left(\bar{X}=\sum_{i=1}^{n} X_{i} / n, \bar{Y}=\sum_{i=1}^{n} Y_{i} / n\right)\). La muestra de 15 estudiantes que utilizaremos para el estudio es la siguiente:

Tabla 2 Notas de COU y de selectividad de 15 estudiantes

| Estudiante núm. | 1 | 2 | 3 | 4 | 5 | 6 | 7 | 8 |

|---|---|---|---|---|---|---|---|---|

| Selectividad | 5.76 | 6.35 | 5.58 | 5.78 | 6.66 | 5.80 | 5.55 | 6.61 |

| COU | 6.78 | 6.60 | 5.62 | 6.06 | 6.88 | 6.14 | 6.00 | 6.86 |

El valor del coeficiente de correlación sobre esta muestra es:

\[ \hat{\rho}=0,776 \]

15.1.2 Estimación del error estándar: soluciones clásica y bootstrap

Una vez calculadas las estimaciones sobre la muestra suele interesar disponer de alguna medida de su fiabilidad.

En el caso de la media muestral podemos calcular su error estándar

\[ \hat{\sigma}_{\bar{X}}=\frac{\sqrt{\sum\left(X_{i}-\bar{X}\right)^{2}}}{n} \]

pero para la mediana y el coeficiente de correlación, no existe una fórmula de validez tan general -es decir rápida de calcular y libre de suposiciones sobre la distribución de la variable o variables- como la anterior.

Antes de pasar a buscar una solución general para el tipo de problema planteado vamos a establecer una formalización que nos permita tratar ambas situaciones de forma unificada:

- Partimos de unos datos, es decir una muestra de una variable aleatoria, unidimensional o multidimensional, que sigue una distribución \(F\).

\[ \mathbf{X}=\left(X_{1}, X_{2}, \ldots, X_{n}\right), \quad \mathbf{X} \sim F \]

- Existe un parámetro de interés \(\theta\), que, como en los ejemplos anteriores, puede ser el valor medio, la mediana o el coeficiente de correlación poblacionales. (Estamos pues suponiendo un modelo estadístico paramétrico \(\left(\Omega, \mathcal{A},\left\{P_{\theta}, \theta \in \Theta\right\}\right)\) o abreviadamente \(\mathbf{X} \sim F_{\theta}, \theta \in \Theta\) ).

- Deseamos estimar \(\theta\) a partir de la muestra.

En las circunstancias anteriores se nos plantean usualmente dos cuestiones básicas:

- Qué estadístico \(\hat{\theta}(\mathbf{X})\) resulta el (más) adecuado para estimar \(\theta\) ?

- Qué tan “preciso” es \(\hat{\theta}\) como estimador de \(\theta\) ?

Una primera aproximación para responder a estas dos preguntas consiste en acudir a la teoría clásica de la estimación máximo-verosímil, que sugiere como solución a la primera pregunta el uso del estimador máximo-verosímil de \(\theta\), llamémosle \(\hat{\theta}_{M V}\).

Bajo condiciones bastante generales esta teoría establece que el estimador máximo verosímil, \(\hat{\theta}_{M V}\), es asintóticamente normal de media igual al valor del parámetro \(\theta\) y de varianza asintótica \(\frac{1}{I(\theta)}\), donde \(I(\theta)\) representa la información de Fisher del modelo.

\[ \hat{\theta}_{M V} \simeq A N\left(\theta, \frac{1}{I(\theta)}\right) \]

Como es habitual en estos casos error estándar de \(\hat{\theta}_{M V}\) se puede aproximar, en muestras grandes, por

\[ \hat{\sigma}_{\hat{\theta}_{M V}} \simeq \frac{1}{\sqrt{I(\hat{\theta})}} \]

donde \(I(\hat{\theta})\) suele denominarse información observada del modelo, frente a \(I(\theta)\) que se denomina al hacer esta distinción, información esperada.

La aplicación del método de la máxima verosimilitud al caso de \(\theta= E_{F}(X)\) nos conduce a

\[ \begin{aligned} \hat{\theta}_{M V} & =\bar{X} \\ \hat{\sigma}_{\hat{\theta}_{M V}} & =\sqrt{\frac{1}{n^{2}} \sum_{i=1}^{n}\left(X_{i}-\bar{X}\right)^{2}} \end{aligned} \]

En el caso de la mediana y el coeficiente de correlación la respuesta no es tan inmediata. Antes de considerar el enfoque bootstrap

15.1.3 Estimadores de substitución (“plug-in”) y Funcionales estadísticos

15.1.3.1 La distribución muestral (o empírica)

Sea \(\left(x_{1}, x_{2}, \ldots, x_{n}\right)\) una realización de una muestra aleatoria simple \(\left(X_{1}, X_{2}, \ldots, X_{n}\right)\) de una v.a. \(X\). Podemos asociar una distribución a las observaciones \(\left(x_{1}, x_{2}, \ldots, x_{n}\right)\) con la pretensión de que, en tanto que la muestra “emula” a la población, \(X\), la distribución de la muestra \(F_{n}(x)\) emule la distribución de la población. Esta distribución se denomina distribución empírica o distribució muestral y se representa por:

\[ F_{n}(x)=F^{*}(x)=F_{n}^{*}(x)=\frac{\sharp d^{\prime} \text { elementos muestrales }}{n} \]

En la práctica se construye ordenando la muestra

\[ x_{1}, x_{2}, \ldots, x_{n} \longrightarrow x_{(1)}<x_{(2)} \ldots<x_{(n)} \]

definiendo:

\[ F_{n}(x)=\left\{\begin{array}{ll} 0 & \text { si } x<x_{(1)} \\ \frac{k}{n} & \text { si } x_{(k)} \leq x<x_{(k+1)} \\ 1 & \text { si } x \geq x_{(n)} \end{array}\right\} \]

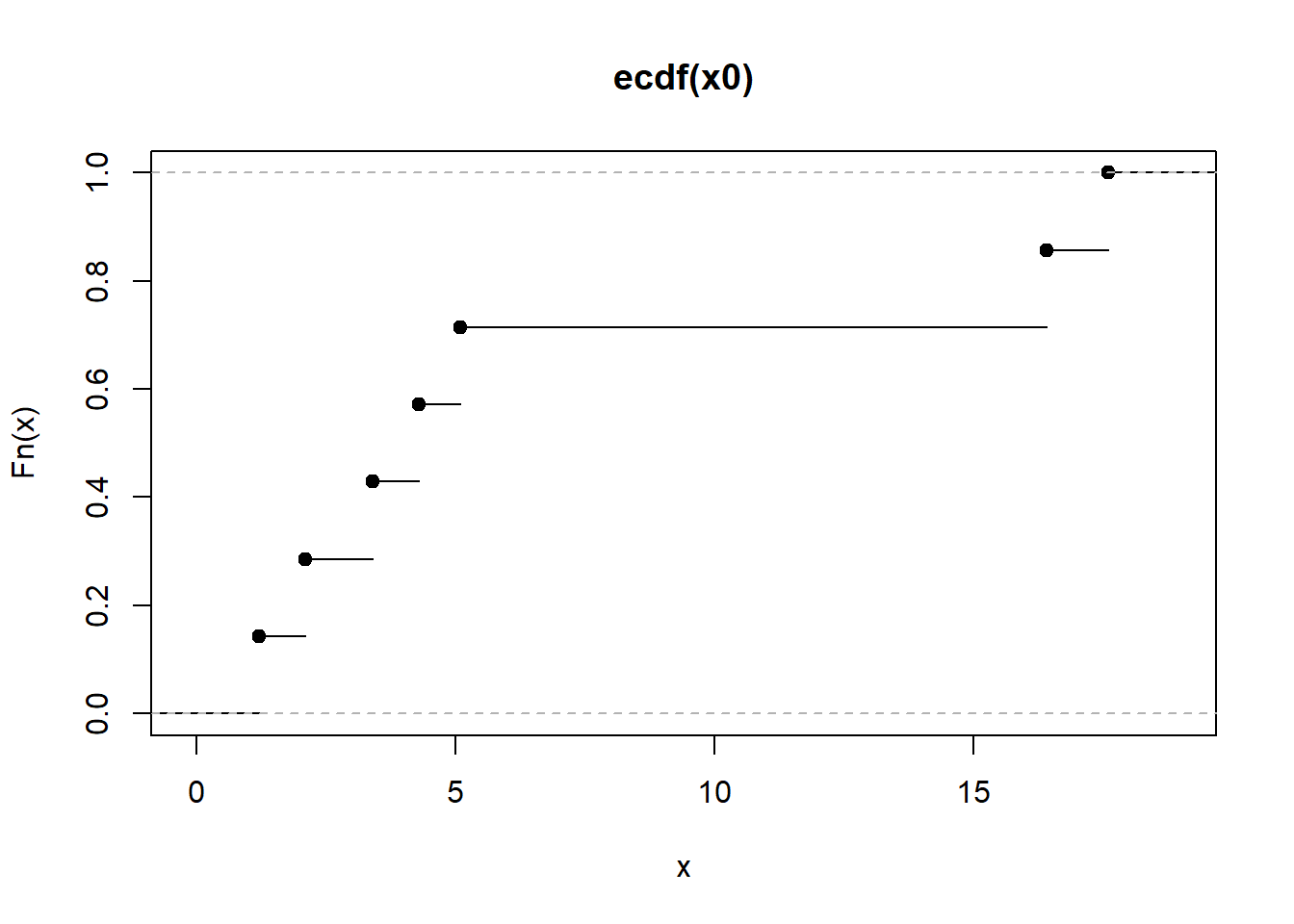

Ejemplo 1 Extraemos una muestra y obtenemos:

| \(x_{1}\) | \(x_{2}\) | \(x_{3}\) | \(x_{4}\) | \(x_{5}\) | \(x_{6}\) | \(x_{7}\) |

|---|---|---|---|---|---|---|

| 5.1 | 3.4 | 1.2 | 17.6 | 2.1 | 16.4 | 4.3 |

Una vez ordenada queda:

\[ \begin{array}{lllllll} x_{(3)} & x_{(5)} & x_{(2)} & x_{(7)} & x_{(1)} & x_{(6)} & x_{(4)} \end{array} \]

y si hacemos la representación gráfica:

La distribución muestral refleja exclusivamente los valores contenidos en la muestra y por lo tanto no se relaciona directamente ni con la distribución (conjunta) de la muestra \(G\left(\left(X_{1}, X_{2}, \ldots, X_{n}\right)\right)\) ni con la distribución de la población: \(F\). Sin embargo, como es razonable esperar \(F_{n}(x)\) proporciona una imagen aproximada de la distribución de la población de donde se ha extraido la muestra. Pueden repasarse las propiedades de la distribución empírica en Velez y García (1993,[23]).

15.1.3.2 Estimadores de substitución

El principio de substitución es un método de estimación, o más bien una idea subyacente en algunos métodos de estimación. El estimador de substitución de un parámetro \(\theta=T(F)\) se define como

\[ \hat{\theta}=T\left(F_{n}\right) . \]

En otras palabras, estimamos la función \(\theta=T(F)\) por la misma función de la función de distribución empírica, \(F_{n}\), o, en general, por la misma función de algún estimador de la función de distribución, \(\hat{F}\).

Un enfoque algo más formal que el anterior consiste en introducir los el concepto de funcional estadístico. Este concepto ha resultado de gran utilidad en diversas áreas de la estadística -como el de la robustez- y que permite utilizar una notación que arroja considerable luz sobre el significado del bootstrap .

Consideremos la situación introducida en el párrafo anterior donde se tiene una muestra de observaciones iid de una cierta función de distribución \(F\), siendo \(F_{n}\) la función de distribución empírica de la muestra. Como hemos indicado, muchos estadísticos importantes pueden representarse como funciones de la función de distribución empírica, llamémosles \(T\left(F_{n}\right)\). Obsérvese que esto significa que \(T\) es una función de algún conjunto \(\mathcal{F}\) de funciones de distribución -al que pertenecen \(F_{n}\) y \(F\) - en \(\mathbf{R}\) :

\[ \begin{aligned} T: \mathcal{F} & \longrightarrow \mathbf{R} \\ G & \longrightarrow T(G) . \end{aligned} \]

(Es habitual denominar funcional a aquellas funciones en que el conjunto origen es, a su vez, un conjunto de funciones).

Por ejemplo para la varianza de \(F, \sigma^{2}\), el funcional relevante es:

\[ T(F)=\int\left[x-\int x d F(x)\right]^{2} d F(x) \]

donde la integral \(\int() d F(x)\) se puede tomar en el sentido de Riemann-Stieltjes, con lo que \(T\left(F_{n}\right)\) es la varianza muestral

\[ T\left(F_{n}\right)=S^{2}=1 / n \sum_{i=1}^{n}\left(x_{i}-\bar{x}\right)^{2} \]

La idea central del uso de estimadores que son funcionales estadísticos y que, por tanto se basan en el principio de substitución es la siguiente: dado que \(F_{n}\) es un estimador razonable de \(F\) puede esperarse que \(T\left(F_{n}\right)\) se relacione con \(T(F)\) de forma similar siempre que el funcional \(T(\cdot)\) se comporte “suficientemente bien” en una entorno de \(F\). Esta idea conduce a la consideración de \(F\) como un punto en una colección \(\mathcal{F}\) de funciones de distribución y a nociones de continuidad, diferenciabilidad y otras propiedades de regularidad que no discutiremos aquí dado que escapan de nuestro objetivo. Para un estudio de los funcionales estadísticos puede consultarse p.ej. Serfling (1980, [20]).

Veamos la utilidad de este enfoque en el problema que nos ocupa:

- Como hemos indicado en la sección anterior nuestro objetivo es estimar algún parámetro \(\theta\), que generalmente podrá expresarse como \(\theta(F)\) siendo \(F\) la función de distribución de cada \(X_{i}\) en \(\left(X_{1}, X_{2}, \ldots, X_{n}\right)\). Por ejemplo:

\[ \begin{aligned} & \theta=E_{F}(X)=\theta(F) \\ & \theta=\operatorname{Med}(X)=\left\{m: P_{F}(X \leq m)=1 / 2\right\}=\theta(F) \end{aligned} \]

- Para estimar \(\theta\) utilizaremos un estimador de substitución \(\hat{\theta}\) ( \(\hat{\theta}\) es un funcional de \(F_{n}\) ), es decir \(\hat{\theta}=\theta\left(F_{n}\right)\). Por ejemplo:

\[ \begin{aligned} & \hat{\theta}=\bar{X}=\int X d F_{n}(x)=\frac{1}{n} \sum_{i=1}^{n} x_{i}=\theta\left(F_{n}\right) \\ & \hat{\theta}=\widehat{\operatorname{Med}}(X)=\left\{m: \frac{\# x_{i} \leq m}{n}=1 / 2\right\}=\theta\left(F_{n}\right) \end{aligned} \]

- Centrándonos en \(\hat{\theta}=\bar{X}\) podemos ver como la medida de precisión que deseamos obtener, su error estándar, también es un funcional de \(F\) :

\[ \sigma_{\bar{X}}=\frac{\sigma(X)}{\sqrt{n}}=\frac{\sqrt{\int\left[x-\int x d F(x)\right]^{2} d F(x)}}{\sqrt{n}}=\sigma_{\bar{X}}(F) \]

y que el estimador de su varianza es el mismo funcional aplicado sobre \(F_{n}\) es decir:

\[ \hat{\sigma}_{\bar{X}}=\frac{\hat{\sigma}(X)}{\sqrt{n}}=\frac{\sqrt{1 / n \sum_{i=1}^{n}\left(x_{i}-\bar{x}\right)^{2}}}{\sqrt{n}}=\sigma_{\bar{X}}\left(F_{n}\right) . \]

Vemos pues que una forma de obtener una estimación del error estándar de un estimador, \(\hat{\sigma}_{\hat{\theta}}\) consiste en substituir \(F\) por \(F_{n}\) en la expresión del error estándar “poblacional” de \(\hat{\theta}, \sigma_{\hat{\theta}}=\sigma_{\hat{\theta}}(F)\), siempre que ésta sea conocida. De forma esquemática el proceso consistirá en:

\[ \sigma_{\hat{\theta}}=\sigma_{\hat{\theta}}(F) \Longrightarrow \sigma_{\hat{\theta}}\left(F_{n}\right)=\widehat{\sigma}_{\hat{\theta}} . \]

El método anterior presenta el inconveniente obvio de que cuando la forma (el funcional) de \(\sigma_{\hat{\theta}}(F)\) es desconocida no es posible realizar la substitución de \(F\) por \(F_{n}\). Este es por ejemplo el caso del error estándar de la mediana o el coeficiente de correlación. En el apartado siguiente se presenta el método bootstrap a partir del cual es posible realizar la aproximación que nos interesa

\[ \hat{\sigma}_{\hat{\theta}} \simeq \sigma_{\hat{\theta}}\left(F_{n}\right) \]

sin que sea necesario conocer la forma de \(\sigma_{\hat{\theta}}(F)\).

15.1.4 El bootstrap

15.1.4.1 Estimación de la distribución en el muestreo

En la sección anterior se ha propuesto el principio de substitución para estimar el error estándar de un estimador, es decir:

\[ \widehat{\sigma_{\hat{\theta}}(F)}=\sigma_{\hat{\theta}}(\hat{F}), \]

supuesta conocida la forma del funcional \(\sigma_{\hat{\theta}}(F)\) y dado un estimador \(\hat{F}\) de \(F\), que suele ser la función de distribución empírica \(F_{n}\).

Sea \(\mathbf{X} \stackrel{\text { i.i.d. }}{\sim} F\) una muestra aleatoria simple y \(\mathcal{R}_{n}(\mathbf{X}, F)\) una función medible de la muestra que por tanto depende también de \(F\) y de \(n\). El estimador \(\hat{\theta}\), considerado hasta el momento, es un caso particular de tal función. Llamemos \(H_{F, n}(x)\) a la función de distribución de \(\mathcal{R}_{n}(\mathbf{X}, F)\), es decir:

\[ H_{F, n}(x)=P\left\{\mathcal{R}_{n}(\mathbf{X}, F) \leq x\right\} \]

En general nos referiremos a ella simplemente como \(H_{F}(x)\), omitiendo la dependencia de \(n\).

Cuando \(\mathcal{R}_{n}(\mathbf{X}, F)=\hat{\theta}\) entonces el error estándar de \(\hat{\theta}\) coincide con la desviación típica de \(\mathcal{R}_{n}(\mathbf{X}, F)\) es decir:

\[ \sigma_{F}(\hat{\theta})=\sqrt{\operatorname{var}_{H}\left(\mathcal{R}_{n}(\mathbf{X}, F)\right)} \]

Una alternativa al conocimiento de la forma de \(\sigma_{\hat{\theta}}(F)\) consiste en estimar directamente la distribución \(H_{F}(x)\) y tomar su varianza como un estimador de \(\operatorname{var}_{H}\left(\mathcal{R}_{n}(\mathbf{X}, F)\right)\), es decir:

\[ \begin{aligned} P_{F}\left\{\mathcal{R}_{n}(\mathbf{X}, F) \leq x\right\}=H_{F}(x) & \doteq H_{F_{n}}(x)=P_{F_{n}}\left\{\mathcal{R}_{n}\left(\mathbf{X}^{*}, F_{n}\right) \leq x\right\} \\ \sigma_{\hat{\theta}}^{2}(F)=\operatorname{var}_{H_{F}}(\hat{\theta}) & \doteq \operatorname{var}_{H_{F_{n}}}(\hat{\theta})=\sigma_{\hat{\theta}}^{2}\left(F_{n}\right) \end{aligned} \]

La notación \(\mathbf{X}^{*}\) hace referencia al hecho de que la muestra proviene de la distribución \(F_{n}\) en vez de \(F\).

- \(\mathbf{X}^{*}\) recibe el nombre de muestra bootstrap o remuestra.

- La distribución \(H_{F_{n}}(x)\) se denominará la distribución bootstrap de \(\mathcal{R}_{n}(\mathbf{X}, F)\).

El principio bootstrap consistirá en utilizar la distribución bootstrap como base para realizar inferencias sobre \(\mathcal{R}_{n}(\mathbf{X}, F)\).

Esta aproximación resulta muy atractiva de entrada, en tanto que permite prescindir de suposiciones previas -como la normalidad de los datos- para hacer inferencia. Existe sin embargo un problema importante y es que, en la mayoria de los casos de interés, no es posible obtener analíticamente la distribución bootstrap de \(\mathcal{R}_{n}(\mathbf{X}, F)\), con lo que aparentemente, el método bootstrap no tendrá ningún interés práctico.

Resulta sin embargo que, en muchos casos, es posible aproximar de forma, razonablemente buena la distribución bootstrap mediante simulación de Monte Carlo. Esto determina que, en la práctica, la situación haya sido la contraria de la descrita en el parrafo anterior, es decir el método ha adquirido una gran popularidad dada la posibilidad que ofrece de realizar inferencia de forma relativamente automática.

Ejemplo 1 Sea \(X\) una variable discreta con distribución de Bernouilli,

\[ X \sim b(1, p), \quad\left\{\begin{array}{l} P(X=1)=\theta \\ P(X=0)=1-\theta \end{array}\right. \]

Sea \(\theta(F)=P(X=1)\) el parámetro de interés cuyo estimador de substitución es \(\widehat{\theta(F)}=\theta\left(F_{n}\right)=\bar{X}\). Sea

\[ \mathcal{R}_{n}(\mathbf{X}, F)=\bar{X}-\hat{\theta}(F) \]

el error de estimación. Dada una muestra \(\mathbf{x}=\left(X_{1}, X_{2}, \ldots, X_{n}\right)\) la probabilidat, condicional, de que en una muestra de \(F_{n}, \mathbf{x}^{*}\), un valor valga 1 será \(\bar{x}\) :

\[ P\left(X_{i}^{*}=1\right)=\bar{x} \Leftrightarrow X^{*} \sim b(1, \bar{x}) . \]

Esto permitirá estimar \(\mathcal{R}_{n}(\mathbf{X}, F)=\bar{X}-\hat{\theta}(F)\) por

\[ \mathcal{R}_{n}\left(\mathbf{X}^{*}, F_{n}\right)=\bar{X}^{*}-\hat{\theta}\left(F_{n}\right)=\bar{X}^{*}-\bar{x} \]

El cálculo exacto de las características de la distribución bootstrap de \(\mathcal{R}_{n}\left(\mathbf{X}^{*}, F_{n}\right)\) puede ahora realizarse, simplemente teniendo en cuenta que, para cualquier remuestra, el valor \(\bar{x}\) es fijo: entre las remuestras \(\bar{x}\) hace el papel de parámetro que correspondia a \(\theta\) entre las muestras. Tenemos pues que, si denominamos \(\operatorname{var}_{B}\left(\mathcal{R}^{*}\right)\) a la varianza bajo la distribución bootstrap de \(\mathcal{R}_{n}\left(\mathbf{X}^{*}, F_{n}\right)\) :

\[ \begin{aligned} \operatorname{var}_{H_{n}}\left(\mathcal{R}_{n}\left(\mathbf{X}^{*}, F_{n}\right)\right) & =\operatorname{var}_{B}\left(\mathcal{R}^{*}\right)=\operatorname{var}_{B}\left(\bar{X}^{*}-\bar{x}\right)=\operatorname{var}_{B}\left(\bar{X}^{*}\right)+0= \\ & =n \frac{\bar{x}}{n} \frac{1-\bar{x}}{n}=\frac{\bar{x}(1-\bar{x})}{n} \end{aligned} \]

El ejemplo anterior refleja una situación, poco habitual, en que es posible obtener el estimador bootstrap de la varianza, analíticamente. Otro ejemplo, correspondiente a la distribución bootstrap de la mediana se encuentra en Efron ([9]). Otra forma de plantear el estudio de la distribución bootstrap consiste en construirla por enumeración de todas las muestras posibles. Excepto en los casos en que el tamaño de la muestra es muy pequeño el problema es difícil de abordar computacionalmente. Holmes ([14]) discute brevemente este problema en http://www-stat.stanford.edu/~susan/courses/s208/node12.html.

15.1.4.2 Muestreo bootstrap de Monte Carlo

Como se ha discutido en la sección anterior la idea básica del bootstrap consiste en estimar el error estándar - u otra característica de la distribución- a partir de muestras bootstrap de \(F_{n}\), que se obtienen substituyendo \(F_{n}\) por \(F\) en la etapa de muestreo (en vez de hacerlo en la cálculo de \(\sigma_{\hat{\theta}}(F)\) ). Es decir en vez de realizar el muestreo:

\[ F \xrightarrow{\text { m.a.s. }} \mathbf{X}=\left(X_{1}, X_{2}, \ldots, X_{n}\right) \]

se hace

\[ F_{n} \xrightarrow{\text { m.a.s. }} \mathrm{X}^{*}=\left(X_{1}^{*}, X_{2}^{*}, \ldots, X_{n}^{*}\right) . \]

Esto significa que muestreamos extrayendo muestras de tamaño \(n\) de \(F_{n}\), es decir que \(\mathrm{X}^{*}=\left(X_{1}^{*}, X_{2}^{*}, \ldots, X_{n}^{*}\right)\) es una muestra aleatoria de tamaño \(n\) obtenida con reemplazamiento de la muestra original ( \(X_{1}, X_{2}, \ldots, X_{n}\) ).

La muestra resultante del muestreo bootstrap, \(\mathbf{X}^{*}\), recibe el nombre de muestra bootstrap o remuestra.

El cálculo del error estándar a partir de las remuestras debe de aproximarse habitualmente mediante un algoritmo de Monte Carlo, dado que no suele conocerse explícitamente la forma de la distribución bootstrap . Este algoritmo consiste en:

- Extraer \(B\) muestras, \(\mathbf{x}_{1}^{*}, \mathbf{x}_{2}^{*}, \ldots, \mathbf{x}_{B}^{*}\) de \(F_{n}\)

- Calcular \(\hat{\theta}\left(\mathrm{x}_{1}^{*}\right), \ldots, \hat{\theta}\left(\mathrm{x}_{B}^{*}\right)\)

- Sea

\[ \overline{\hat{\theta}} \equiv \frac{1}{B} \sum_{b=1}^{B} \hat{\theta}\left(\mathrm{x}_{b}^{*}\right) \]

entonces el el error estándar bootstrap de \(\hat{\theta}, \sigma_{B}(\hat{\theta})\) se puede aproximar por:

\[ \hat{\sigma}_{B}(\hat{\theta})=\sqrt{\frac{1}{(B-1)} \sum_{b=1}^{B}\left(\hat{\theta}\left(\mathbf{x}_{\mathbf{i}}^{*}\right)-\overline{\hat{\theta}}\right)^{2}} \]

Cuando

\[ B \rightarrow \infty \quad \Longrightarrow \hat{\sigma}_{B}(\hat{\theta}) \rightarrow \hat{\sigma}_{\infty}(\hat{\theta})=\sigma_{B}(\hat{\theta})=\hat{\sigma}_{\hat{\theta}}\left(F_{n}\right) \]

15.1.5 Ejemplo 1 (continuación)

Como hemos visto anteriormente el muestreo bootstrap equivale a tomar muestras con reemplazamiento de la muestra original -es decir extraer \(n\) valores de la muestra original con probabilidad \(1 / n\) para cada uno de ellossobre las que se calcula el estimador del parámetro de interés. En los listados siguientes \({ }^{1}\) se puede ver el aspecto de las primeras remuestras de un muestreo bootstrap con \(B=100\) y el valor del parámetro calculado sobre cada una de ellas.

Ejemplo núm 1: Muestra inicial de 9 tiempos de supervivencia y 5 remuestras extraídas de ella.

Muestra original

Datos para calcular el error estándar bootstrap de la mediana.

0.14 0.18 0.25 0.26 0.37 0.44 0.51 0.61 0.71

El valor del parámetro sobre la muestra original es: 0.37

Remuestra numero: 1

0.14 0.26 0.37 0.44 0.51 0.51 0.61 0.61 0.71

El valor del parámetro sobre la remuestra n : 1 es: 0.51

Remuestra numero: 2

0.14 0.18 0.18 0.26 0.37 0.61 0.71 0.71 0.71

El valor del parámetro sobre la remuestra n : 2 es: 0.37

Remuestra numero: 3

0.18 0.18 0.18 0.25 0.26 0.26 0.26 0.37 0.44

El valor del parámetro sobre la remuestra n : 3 es: 0.26

Remuestra numero: 4

0.14 0.18 0.18 0.25 0.26 0.44 0.51 0.51 0.71

El valor del parámetro sobre la remuestra n : 4 es: 0.26

Remuestra numero: 5

0.18 0.26 0.26 0.26 0.37 0.37 0.44 0.51 0.71

El valor del parámetro sobre la remuestra n : 5 es: 0.37Ejemplo núm 2: Muestra de notas de COU y selectividad de 15 estudiantes de primer curso de universidad

[^0]Un hecho que merece la pena comentar, en tanto que en una primera aproximación puede generar dudas, es como se realiza el remuestreo en variables bidimensionales o \(k\)-dimensionales. La respuesta es, evidentemente, que en una muestra de tamaño \(n\) deben sacarse \(n\) pares, en variables bidimensionales, o \(k\)-tuplas, en variables \(k\)-dimensionales, con reemplazamiento, manteniendo siempre juntos las coordenadas originales en cada punto.

Muestra inicial Datos para calcular el error estándar bootstrap

del coeficiente de correlaci\'on.

(5.76, 6.78)( 6.35, 6.60)( 5.58, 5.62)( 5.78, 6.06)

( 6.66, 6.88)( 5.80, 6.14)( 5.55, 6.00) ( 6.61, 6.86)

( 6.51, 6.72) ( 6.05, 6.26) ( 6.53, 6.24) ( 5.75, 5.48)

( 5.45, 5.52) ( 5.72, 5.76) ( 5.94, 5.92)

El valor del parámetro sobre la muestra original es: 0.776

Remuestra no 1:(5.55, 6.00)( 6.66, 6.88)( 5.72, 5.76)

( 6.51, 6.72) ( 6.53, 6.24) ( 5.75, 5.48) ( 5.72, 5.76)

(5.78, 6.06)( 5.58, 5.62)( 5.94, 5.92)( 6.35, 6.60)

( 6.05, 6.26)( 5.78, 6.06)( 5.76, 6.78)( 5.80, 6.14)

El valor del parámetro sobre la remuestra n : 1 es: 0.71

Remuestra numero: 2 ( 6.61, 6.86) ( 6.35, 6.60) ( 6.61,

6.86) ( 6.66, 6.88)( 6.61, 6.86)( 5.75, 5.48)( 6.53,

6.24) ( 5.72, 5.76) ( 5.80, 6.14) ( 6.35, 6.60) ( 5.72,

5.76) ( 6.35, 6.60) ( 5.45, 5.52) ( 5.55, 6.00) ( 5.80,

6.14) El valor del parámetro sobre la remuestra no: 2 es: 0.91

Remuestra numero: 3( 5.76, 6.78)( 5.45, 5.52)( 5.58,

5.62) ( 5.45, 5.52) ( 5.80, 6.14) ( 6.61, 6.86) ( 6.35,

6.60) ( 6.66, 6.88)( 5.76, 6.78)( 5.94, 5.92)(5.55,

6.00) ( 5.75, 5.48)( 5.45, 5.52)( 6.05, 6.26)( 5.55,

6.00) El valor del parámetro sobre la remuestra no: 3 es: 0.75Realizado el remuestreo se obtienen los siguientes resultados:

- Media muestral \(\hat{\sigma}_{100}=0,156, \quad \sigma_{\infty}=, 155\) \(\left(\hat{\sigma}_{\infty}=\frac{1}{n^{2}}\left[\sum\left(X_{i}-\bar{X}\right)^{2}\right]^{1 / 2}\right)\) El ajuste entre la estimación bootstrap y el valor teórico es muy bueno.

- Mediana muestral \(\hat{\sigma}_{100}=, 106\)

- Coeficiente de correlación \(\hat{\sigma}_{100}=, 130 \quad \sigma_{\infty}=, 114\) ( \(\hat{\sigma}_{\infty}\) representa el error estándar del coeficiente de correlación según la teoría normal).

En general para estimar errores estándares basta con \(B=100\). P.ej. en el caso de la mediana del ejemplo anterior se obtiene:

| B | 25 | 50 | 100 | 250 | 1000 |

|---|---|---|---|---|---|

| \(\widehat{\sigma_{B}}\) | .087 | .109 | .106 | .102 | .102 |

15.1.6 Resumen: del mundo real al mundo bootstrap

Podemos resumir lo visto hasta aquí en las ideas siguientes:

- La mayoría de los métodos usuales para obtener errores estándares son versiones aproximadas de:

\[ \hat{\sigma}=\sigma\left(F_{n}\right) \]

- El bootstrap permite evaluar \(\sigma\left(F_{n}\right)\) directamente a base de “fuerza bruta” (método de Monte Carlo).

Esquemáticamente se puede considerar que al aplicar el bootstrap disponemos de alguna forma de estimación del modelo completo de probabilidad \(P=P_{F}\), a partir de los datos observados \(\mathbf{X}\), y sabemos como producir un modelo estimado \(\hat{P}=P_{F_{n}}\). Este el paso crucial del método.

Una vez disponemos del modelo estimado \(\hat{P}\) podemos utilizar el método de Monte Carlo para generar remuestras, \(\mathbf{X}^{*}\), según las mismas reglas por las que los datos originales son generados de \(P\). La variable bootstrap, \(\hat{\theta}\left(\mathbf{X}^{*}\right)\), es observable dado que conocemos \(\hat{P}\) y \(\mathbf{X}^{*}\) con lo que el muestreo de Monte Carlo nos permitirá conocer la distribución de \(\hat{\theta}\left(\mathbf{X}^{*}\right)\). De esta forma podremos sobre ella estimar las características que nos interesen como, en nuestro ejemplo, el error estándar, que será \(\operatorname{Var}_{\hat{P}}\left[\hat{\theta}\left(\mathbf{X}^{*}\right)\right]\).

15.1.7 Otros aspectos

15.1.7.1 Bootstrap paramétrico y no paramétrico

En ocasiones puede disponerse de información sobre la forma de \(F\). Por ejemplo, se puede aceptar razonablemente que el tiempo de vida sigue una distribución exponencial. Si esta suposición se considera válida, la distribución dependerá tan solo del parámetro \(\alpha=\left(E_{F} X\right)^{-1}\).

En vez de estimar \(F\) por \(F_{n}\) y generar las remuestras a partir de ésta, un procedimiento alternativo consiste en estimar el parámetro -p.ej. mediante su estimador máximo-verosímil, llamémosle \(\hat{\alpha}_{M V}-\) y obtener las remuestras generando muestras de una distribución exponencial de parámetro \(\hat{\alpha}_{M V}\).

Es decir en vez de remuestrear aproximando \(F=F_{\alpha}\) por \(F_{n}\) y extrayendo muestras con reemplazamiento de la muestra original:

\[ F_{\alpha} \simeq F_{n} \quad \xrightarrow{\text { m.a.s. }} \mathbf{X}^{*}=\left(X_{1}^{*}, X_{2}^{*}, \ldots, X_{n}^{*}\right) . \]

lo haremos aproximando \(F_{\alpha}\) por \(F_{\hat{\alpha}_{M V}}\) y generando mediante métodos de Monte Carlo, muestras a partir de esta distribución.

\[ F_{\alpha} \simeq F_{\hat{\alpha}_{M V}} \quad \xrightarrow{\text { m.a.s. }} \quad \mathbf{Y}^{*}=\left(Y_{1}^{*}, Y_{2}^{*}, \ldots, Y_{n}^{*}\right) \]

Este procedimiento se conoce como Bootstrap paramétrico. Una diferencia obvia con el procedimiento anterior es que, en general, los elementos de la remuestra no pertenecerán a la muestra original.

Ejemplo 1 Si en el ejemplo número 1, en donde considerábamos los tiempos de supervivencia, realizamos la suposición, razonable, de que éstos se distribuyen según una distribución exponencial

\[ f(x ; \alpha)=\alpha \exp (-\alpha x), x>0, \alpha>0 \]

podemos utilizar el estimador \(F_{\alpha} \simeq F_{\hat{\alpha}_{M V}}\), en donde

\[ \hat{\alpha}_{M V}=\frac{1}{\bar{x}} \]

Para generar muestras según la distribución exponencial nos podemos basar en el procedimiento de inversión que, aplicado a la función de distribución de la ley exponencial, garantiza que la variable

\[ X=-\frac{1}{\alpha} \ln (1-U), \quad U \sim \operatorname{Unif.}(0,1), \]

sigue una distribución exponencial \({ }^{2}\).

15.1.7.2 Numero de remuestras necesario

Como ya hemos comentado suele ser necesario recurrir a algún tipo de muestreo de Monte Carlo para evaluar los estimadores bootstrap. Una pregunta de inminente interés práctico es cuantas remuestras deben realizarse para que la aproximación de Monte Carlo del estimador bootstrap se aproxime “razonablemente” al auténtico valor del estimador bootstrap. Si llamamos:

- \(\sigma_{F}(\hat{\theta})\) al error estándar de \(\hat{\theta}\),

- \(\sigma_{\hat{F}}(\hat{\theta})=\sigma_{B}(\hat{\theta})\) al estimador bootstrap del error estándar de \(\hat{\theta}\), y

- \(\hat{\sigma}_{\hat{F}}(\hat{\theta})=\hat{\sigma}_{B}(\hat{\theta})\) a la aproximación de Monte Carlo del estimador bootstrap del error estándar de \(\hat{\theta}\), la pregunta relevante es cuan mayor es el error cometido para estimar \(\sigma_{F}(\hat{\theta})\) si, en vez de basarnos en \(\sigma_{B}(\hat{\theta})\) lo hacemos en \(\hat{\sigma}_{B}(\hat{\theta})\) ?

Efron ([11])deduce una fórmula para el coeficiente de variación (es decir el cociente entre la desviación típica y la esperanza) de \(\hat{\sigma}_{B}(\hat{\theta})\), condicional sobre una muestra dada:

\[ C V\left(\hat{\sigma}_{B}(\hat{\theta}) \mid \mathbf{x}\right)=\left[\frac{\hat{\Delta}+2}{4 B}\right]^{1 / 2} \]

donde \(\hat{\Delta}\) es la curtosis de la distribución (bootstrap) de \(\hat{\theta}\). La notación indica que los datos observados, \(\mathbf{x}\), se consideran fijos en esta expresión. Cuando \(B \rightarrow \infty\) la expresión anterior \(\rightarrow 0\) y \(\sigma_{B} \rightarrow \hat{\sigma}\) el estimador bootstrap del error estándar, “ideal”. Sean ahora \(C V\left(\sigma_{B}(\hat{\theta})\right)\) y \(C V\left(\hat{\sigma}_{B}(\hat{\theta})\right)\) los coeficientes de variación incondicionales (es decir los CV condicionales promediados sobre

[^1]todas las posibles muestras) de \(\sigma_{B}(\hat{\theta})\) y \(\hat{\sigma}_{B}(\hat{\theta})\) respectivamente. En este caso la relación entre ambos coeficientes de variación viene dada por la expresión: \[ C V\left(\hat{\sigma}_{B}(\hat{\theta})\right) \doteq\left\{\left[C V\left(\sigma_{B}\right)\right]^{2}+\left[\frac{E[\hat{\Delta}]+2}{4 B}\right]^{1 / 2}\right\} \]

La tabla siguiente muestra \(C V\left(\hat{\sigma}_{B}\right)\) para diversos valores de \(B\) y \(C V\left(\sigma_{B}\right)\) suponiendo que sea \(E[\hat{\Delta}]=0\). Valores de \(C V\left(\sigma_{B}\right) \geq 0,10\), lo que, según Efron [11], es habitual en la práctica, se observa poca mejora a partir de \(B=100\), lo que sugiere que, para estimar el error estándar este puede ser un número de remuestras adecuado.

| B | |||||

|---|---|---|---|---|---|

| \(C V(\hat{\sigma})\) | 25 | 50 | 100 | 200 | \(\infty\) |

| .25 | .29 | .27 | .26 | .25 | .25 |

| .20 | .24 | .22 | .21 | .21 | .20 |

| .15 | .21 | .18 | .17 | .16 | .15 |

| .10 | .17 | .14 | .12 | .11 | .10 |

| .05 | .15 | .11 | .09 | .07 | .05 |

| 0 | .14 | .10 | .07 | .05 | 0 |

Razonamientos similares sugieren que para los intervalos de confianza el número de remuestras debería ser mucho mayor, del orden de 1000 o 2000.

En un artículo de Booth y Sarkar ([3]) se critica el razonamiento anterior argumentando que es preciso controlar la variabilidad derivada del remuestreo de Monte Carlo, para evitar que las conclusiones del uso del bootstrap difieran entre dos repeticiones del mismo cálculo como resultado de factores como las semillas de los generadores de números aleatorios.

15.1.8 Ejercicios

- Sea \(x_{(1)}<x_{(2)}<\ldots<x_{(7)}\) una muestra ordenada de tamaño \(n=7\). Sea \(\mathbf{x}^{*}\) una muestra bootstrap y \(s\left(\mathbf{x}^{*}\right)\) la correspondiente replica bootstrap de la mediana. Muestre que:

- \(s\left(\mathbf{x}^{*}\right)\) coincide con uno de los valores originales de la muestra \(x_{(i)}\), \(i=1,2, \ldots 7\).

- \(P\left[s(\mathbf{x})=x_{(i)}\right]=p(i)\) donde

\[ p(i)=\sum_{j=0}^{3}\left\{\operatorname{Bi}\left(j ; n, \frac{i-1}{n}\right)-\operatorname{Bi}\left(j ; n, \frac{i}{n}\right)\right\}, \]

donde \(\operatorname{Bi}(j ; n, p)\) es la probabilidad binomial \(\binom{n}{j} p^{j}(1-p)^{n-j}\). (Los valores numéricos de \(p(i)\) son \(.0102, .0981, .2386, .3062, .2386\), .0981, .0102.) Estos valores se utilizaron para calcular un error estándar \(\hat{\sigma}_{B=\infty}\) (mediana) \(=37,83\) con el grupo tratamiento con los datos de supervivencia de \(9+9\) ratones (“mouse data set”). 2. Aplique la ley débil de los grandes números para demostrar que, si \(s\left(\mathbf{x}^{*}\right)\) es la media muestral \(\bar{x}\) el estimador bootstrap del error estándar

\[ \hat{\sigma}_{B}=\left\{\frac{1}{(B-1)} \sum_{b=1}^{B}\left[s\left(\mathbf{x}_{b}^{*}\right)-s(\cdot)\right]^{2}\right\}^{\frac{1}{2}} \]

siendo \(s(\cdot)=\sum_{b=1}^{B} s\left(\mathbf{x}^{*}{ }_{b}\right) / B\), tiende hacia

\[ \left\{\sum_{i=1}^{n}\left(x_{i}-\bar{x}\right)^{2} / n^{2}\right\}^{\frac{1}{2}}, \]

cuando \(n\) tiende a infinito. 3. Tomamos una muestra aleatoria de tamaño \(n\) con reemplazamiento de una población de tamaño \(N\). Muestre que la probabilidad de que no aparezcan repeticiones en la muestra se obtiene del producto:

\[ \prod_{j=0}^{n-1}\left(1-\frac{j}{N}\right) . \]

- Sean \(\bar{X}\) y \(S\) la media y la desviación típica de un conjunto de \(N\) valores \(X_{1}, X_{2}, \ldots, X_{N}\) :

\[ \bar{X}=\sum_{i=1}^{N} X_{i}, \quad S=\left\{\sum_{i=1}^{N}\left(X_{i}-\bar{X}\right)^{2} / N\right\}^{\frac{1}{2}} . \]

- Extraemos una muestra \(\left(x_{1}, x_{2}, \ldots, x_{n}\right)\) de \(X_{1}, \ldots, X_{N}\) con reemplazamiento. La desviación típica de la media muestral, \(\bar{x}=\sum_{i=1}^{n} x_{i}\), se indica como \(\sigma_{\bar{x}}, \mathrm{y}\) suele denominarse el error estándar de la media. Demuestre que:

\[ \sigma_{\bar{x}}=\frac{S}{\sqrt{n}} \]

- Supongamos que el muestreo se realiza sin reemplazamiento (es decir es preciso que \(n \leq N\). Demuestre que:

\[ \sigma_{\bar{x}}=\frac{S}{\sqrt{n}}\left[\frac{N-n}{N-1}\right]^{\frac{1}{2}} \]

- Como puede verse el muestreo sin reemplazamiento da lugar a un menor error para \(\bar{x}\). Proporcionalmente qué tan menor será en el caso de los datos de las escuelas norteamericanas de abogacía \((N=84, n=15)\) ?.

- Dado un conjunto de \(n\) valores distintos pruebe que el número de muestras bootstrap distintas es:

\[ \binom{2 n-1}{n .} \]

Cuantas son para \(n=15 ?\).

15.1.9 Practicas

- Es posible, aunque poco práctico implementar el bootstrap por uno mismo en cualquier lenguaje de ordenador.

- Las instrucciones contenidas en BOOTSD1. R y BOOTSD1B. \(\mathrm{R}^{3}\) en realizan remuestreo no paramétrico sobre la media de tiempo de supervivencia de 9 ratones asignados a un tratamiento destinado a prolongar la supervivencia después de una intervención quirúrgica. El resultado se compara con el error estándar de la media.

- Las instrucciones contenidas en BOOTSD2.R realizan remuestreo no paramétrico sobre la mediana del tiempo de supervivencia de 9 ratones asignados a un tratamiento destinado a prolongar la supervivencia después de una intervención quirúrgica. El resultado se compara con el error estándar teórico de la mediana,

\[ \sqrt{\operatorname{var}(\widehat{M})}=\sqrt{\frac{1}{4 n \cdot[f(\widehat{M})]^{2}}}, \]

donde \(f()\) es la función de densidad evaluada en la mediana de la muestra, \(\widehat{M} . f()\) se estima mediante un estimador kernel. c) Las instrucciones contenidas en BOOTSD3. R y BOOTSD3B. R realizan remuestreo no paramétrico sobre el coeficiente de correlación de las notas de COU y selectividad de 15 estudiantes. En este caso no disponemos, en general, de una fórmula teórica con la que comparar y, en todo caso la varianza auténtica debe estimarse por simulación. 2. En ocasiones se dispone de alguna hipótesis razonable sobre la distribución de los datos, lo cual sugiere la utilización de un remuestreo paramétrico. Modificar el mecanismo de remuestreo del ejercicio anterior para que las remuestras del tiempo de supervivencia se realicen mediante la generación de muestras de tamaño \(\mathrm{n}=9\) de una distribución exponencial de parámetro \(\alpha=\bar{x}\). Comparar los resultados obtenidos con los del remuestreo no paramétrico. 3. El jackknife ofrece un procedimiento alternativo al bootstrap para estimar la varianza de un estimador. Modifique las rutinas del ejercicio 1

[^2]para calcular también el estimador jackknife de la varianza de los estimadores. Compárelo con el estimador bootstrap. (Solución JACKSD1.R ) 4. El bootstrap, junto con el jackknife pueden utilizarse para estimar el sesgo y para obtener estimadores corregidos para el sesgo.A partir de la siguiente muestra obtenida mediante un generador de números aleatorios \(\mathrm{N}(0,1)\) \[ \begin{aligned} \mathbf{X}= & 0,3996,1,5074,0,5640,-1,3542,-0,5846,0,4271,-0,7518 \\ & 0,4622,-0,4563,-0,0783 \end{aligned} \] a) Calcular el sesgo bootstrap y jackknife del estimador de la varianza muestral y compararlo con el estimador exacto \(\frac{-1}{n} \sigma^{2}\), que en este ejemplo es conocido al proceder los datos de una distribución simulada. b) Repetir varias veces los cálculos y observe como varían las estimaciones. ¿Como explica la variación observada?. c) ¿Como se modifica la variabilidad de las estimaciones del sesgo al aumentar el número de remuestras?. Podemos estimar esta variabilidad mediante simulación o mediante jackknife after bootstrap 5. Si no se dispone de un “patron-oro” con el que comparar las estimacionesbootstrap, jackknife u otras- del error estándar pueden validarse estos métodos por simulación. Por ejemplo, para realizar esta validación en el caso del error estándar bootstrap del coeficiente de correlación ejecutaremos el siguiente algoritmo: a) Repetir un elevado número de veces \(s=1, \ldots, S\) (p.ej. \(S=10000\) ) el siguiente proceso:

- Generar una muestra de una distribución bivariante, p.ej. una normal, \(N(\mu, \boldsymbol{\Sigma})\).

- Calcular sobre ella el coeficiente de correlación \(\hat{\rho}_{s}\), y el error estándar bootstrap \(\hat{\sigma}_{B}\)

- La desviación típica muestral, \(s_{\hat{\rho}}\) de los coeficientes de correlación \(\hat{\rho}_{1}, \ldots, \hat{\rho}_{s}\) es una buena estimación del error estándar de \(\hat{\rho}\) y la media muestral de los errores estándar bootstrap, \(\overline{\hat{\sigma}}_{B}\) es una buena estimación del error estándar bootstrap del coeficiente de correlación. \(c)\) Cuanto más similares sean \(s_{\hat{\rho}}\) y \(\overline{\hat{\sigma}}_{B}\) mejor será la calidad de \(\hat{\sigma}_{B}\) cómo estimador de \(\sigma_{\hat{\rho}}\).

15.2 Estimación y corrección del sesgo de un estimador

15.2.1 Introducción

Supongamos que tenemos un modelo estadístico paramétrico, \(X \sim F_{\theta}\), una muestra aleatoria simple de \(X\),

\[ \mathbf{X}=X_{1}, X_{2}, \ldots, X_{n} \]

y un estimador \(\hat{\theta}=T\left(X_{1}, X_{2}, \ldots, X_{n}\right)\) del parámetro. Una forma razonable de valorar qué tan próximos son los valores de \(\hat{\theta}\) de los de \(\theta\) es ver si, en promedio, los valores de \(\hat{\theta}\) coinciden con el valor medio de \(\theta\).

Bajo las condiciones anteriores, si \(E_{F}(T(\mathbf{X}))\) representa la esperanza de \(\hat{\theta}=T\left(X_{1}, X_{2}, \ldots, X_{n}\right)\) la diferencia

\[ b_{F}(T)=E_{F}(T(\mathbf{X}))-\theta \]

recibe el nombre de sesgo del estimador \(\hat{\theta}\) para estimar \(\theta\). Si el sesgo vale cero, es decir si:

\[ \theta=E_{F}(T(\mathbf{X})), \forall \theta \in \Theta \]

diremos que \(\hat{\theta}\) es un estimador insesgado de \(\theta\). Ejemplo 1 Los dos ejemplos mas habituales son la media y la varianza muestrales

- La media muestral es un estimador sin sesgo de \(\mu\).

- La varianza muestral es un estimador sesgado de la varianza poblacional. En concreto el sesgo vale \(\frac{-1}{n} \sigma^{2}\).

El uso de estimadores sin sesgo es conveniente en muestras de tamaño grande puesto que, en éstas, \(\operatorname{Var}_{\theta}(\hat{\theta})\) es a menudo pequeña y entonces si \(E_{F}(\hat{\theta})=\theta+b_{F}(\theta)\) es muy probable obtener estimaciones centradas en este valor en vez de en el entorno de \(\theta\).

Ejemplo 2 Sea \(X_{1}, X_{2}, \ldots, X_{n}\) una muestra aleatoria simple de \(X \sim U(0, \theta)\). Sea \(T_{1}=\max_{1 \leq i \leq n}\left(X_{i}\right)\) el estimador del máximo de la distribución. Obviamente podemos decir que \(T_{1}<\theta\) y por tanto la estimación es siempre sesgada. La distribución en el muestreo de \(T_{1}\) es

\[ H_{\theta}(\theta)=P_{\theta}\left[T_{1} \leq t\right]=\left(\frac{t}{\theta}\right)^{n} \]

\(y\) su función de densidad

\[ f_{\theta}(\theta)=H_{\theta}^{\prime}(\theta)=\frac{n}{\theta}\left(\frac{t}{\theta}\right)^{n-1} \]

El valor medio de vale:

\[ E_{F}(t)=\int_{0}^{\theta} t \cdot\left[\frac{n}{\theta}\left(\frac{t}{\theta}\right)^{n-1}\right] d t=\left.\frac{n}{\theta^{n}} \frac{t^{n+1}}{n+1}\right|_{0} ^{\theta}=\frac{n}{n+1} \frac{\theta^{n+1}}{\theta^{n}}=\frac{n}{n+1} \theta \]

de donde el sesgo de \(T_{1}\) para estimar \(\theta\) vale

\[ b_{F}(\theta)=\frac{n}{n+1} \theta-\theta=-\frac{1}{n+1} \theta \]

Podemos preguntarnos sino podríamos mejorar este estimador corrigiendo el sesgo de forma análoga a como se suele hacer con \(\hat{S}^{2} y\) así utilizar el estimador \(T_{1}^{\prime}=\frac{n+1}{n} T_{1}\) que verifica \(E\left(T_{1}^{\prime}\right)=\theta\). Si buscamos el estimador de mínimo, riesgo en el sentido del error cuadrático medio, es decir el estimador que minimiza \(E\left[(\theta-T)^{2}\right]\) obtenemos

\[ T_{k}=\frac{n+2}{n+1} T_{1} \]

que es preferible a \(T_{1}\) pero no es insesgado puesto que:

\[ E_{\theta}\left(T^{\prime \prime}\right)=\frac{n+2}{n+1} E_{\theta}\left(T_{1}\right)=\frac{(n+2) n}{(n+1)^{2}} \theta \]

El ejemplo anterior muestra que debido a la descomposición

\[ E Q M_{F}(T)=\operatorname{Var}_{F}(T)+b_{F}^{2}(T) \]

puede ser preferible un estimador sesgado a uno insesgado. En general, sin embargo, eliminar el sesgo no es una mala estrategia. Esto viene avalado por la teoría de la estimación sin sesgo en donde restringiendo la clase de los estimadores a los estimadores insesgados se obtiene una solución constructiva que permite obtener estimadores insesgados de varianza mínima en condiciones bastante generales. En el contexto actual dicha teoría no suele tener aplicación por lo que vamos considerar formas de reducir el sesgo mediante aplicación de los métodos de remuestreo.

15.2.2 Estimación bootstrap del sesgo

Si en la definición del sesgo

\[ b_{F}(T)=E_{F}(T(\mathbf{X}))-\theta(F) \]

en donde \(\theta(F)\) indica la dependencia del parámetro respecto de la distribución \(F\), substituimos \(F\) por una estimación \(\hat{F}\), obtendremos el estimador bootstrap del sesgo:

\[ b_{\hat{F}}(T)=E_{\hat{F}}\left(T\left(\mathbf{X}^{*}\right)\right)-\theta(\hat{F}) \]

Algunas observaciones importantes sobre esta definición son las siguientes:

- La substitución de \(F\) por \(\hat{F}\) se realiza en dos puntos: \(E_{F}(T(\mathbf{X}))\) y en \(\theta(F)\)

- Definiendo así el estimador bootstrap del sesgo no es preciso que \(T(\mathbf{X})\) sea un estimador de substitución pero si debe serlo \(\theta(\hat{F})\).

En ocasiones será posible calcular directamente \(b_{\hat{F}}(T)\), siempre que sepamos cómo calcular \(E_{\hat{F}}\left(T\left(\mathbf{X}^{*}\right)\right)\) y \(\theta(\hat{F})\), pero en general será preciso aproximarlos por remuestreo de Monte Carlo mediante los mismos algoritmos de remuestreo que hemos visto en el capítulo anterior. Veamos algunos ejemplos en los que es posible el cálculo exacto de \(b_{\hat{F}}(T)\).

Ejemplo 1 Si \(\theta(F)\) es la media de la distribución, \(\theta(F)=\int X d F, y T(\mathbf{X})\) es la media muestral entonces

\[ \begin{aligned} b_{\hat{F}}(T) & =E_{\hat{F}}\left(T\left(\mathbf{X}^{*}\right)\right)-\theta(\hat{F})=E_{\hat{F}}\left(\overline{\mathbf{X}^{*}}\right)-\bar{X} \\ & =E_{\hat{F}}\left(\frac{1}{n} \sum X_{i}^{*}\right)-\bar{X}=\bar{X}-\bar{X}=0 \end{aligned} \]

es decir el estimador bootstrap del sesgo es cero coincidiendo con el sesgo auténtico de \(\bar{X}\) para estimar \(\mu\).

Ejemplo 2 Si \(\theta(F)\) es la varianza de la distribución, \(\theta(F)=\int\left(X-\int X d F\right)^{2} d F\), y \(T(\mathbf{X})\) es la varianza muestral entonces es fácil ver que

\[ \begin{array}{r} b_{F}(T)=-\frac{1}{n} \sigma^{2} y \\ b_{\hat{F}}(T)=-\frac{1}{n^{2}} \sum\left(X_{i}-\bar{X}\right)^{2} \end{array} \]

Como hemos indicado estos y otros casos sencillos suelen ser la excepción. En general deberemos recorrer a remuestreo de Monte Carlo para estimar \(b_{\hat{F}}(T)\). El algoritmo es muy similar al utilizado para estimar el error estándar:

- Extraer \(B\) muestras, \(\mathbf{X}_{1}^{*}, \mathbf{X}_{2}^{*}, \ldots, \mathbf{X}_{B}^{*}\) de \(F_{n}\)

- Calcular \(T\left(\mathbf{X}_{1}^{*}\right), \ldots, T\left(\mathbf{X}_{B}^{*}\right)\)

- Sea

\[ \overline{\hat{\theta}^{*}} \equiv \frac{1}{B} \sum_{b=1}^{B} \hat{\theta}\left(\mathbf{X}_{b}^{*}\right) \]

entonces el estimador bootstrap del sesgo, \(b_{\hat{F}}(T)\) se puede aproximar por:

\[ \widehat{b_{\hat{F}}(T)}=\overline{\hat{\theta}^{*}}-T(\mathbf{X}) \]

15.2.3 Ejemplo 1. Estimación del sesgo del estimador de la varianza

Supongamos que tomamos una muestra de una población normal de media \(\mu=0\) y varianza conocida \(\sigma^{2}=1\). El estimador de substitución de la varianza es

\[ T(\mathbf{X})=S^{2}=\frac{1}{n} \sum\left(X_{i}-\bar{X}\right)^{2} \]

En este caso podemos calcular el sesgo exacto y el estimador bootstrap del sesgo. Si a continuación calculamos el estimador bootstrap aproximado del sesgo podremos compararlo con los anteriores.

Una muestra de tamaño \(n=10\) de dicha distribución, obtenida mediante un generador de números aleatorios, es la siguiente

\[ \begin{gathered} \mathbf{X}=0,3996,1,5074,0,5640,-1,3542,-0,5846,0,4271,-0,7518, \\ 0,4622,-0,4563,-0,0783 . \end{gathered} \]

La varianza muestral estimada sobre la muestra vale:

\[ S^{2}(\mathbf{X})=0,60971 . \]

El el sesgo exacto y el estimador bootstrap del sesgo valen respectivamente:

\[ \begin{aligned} b_{F}(T) & =-\frac{1}{n} \sigma^{2}=-0.1 \times 1=0.1 \\ b_{\hat{F}}(T) & =-\frac{1}{n^{2}} \sum\left(X_{i}-\bar{X}\right)^{2}=-\frac{0,60971}{10}=-0,060971 . \end{aligned} \]

Para obtener la aproximación de Monte Carlo realizamos 100 remuestras, estimamos \(S^{2}\) sobre cada una de ellas y calculamos el promedio de las 100 estimaciones. El estimador bootstrap aproximado del sesgo vale

\[ \begin{aligned} \widehat{b_{\hat{F}}\left(S^{2}\right)} & =\overline{S^{2 *}}-S^{2}(\mathbf{X})= \\ & =0,57060-0,60971=-0,03911 \end{aligned} \]

Es importante observar que este valor se halla influido por el remuestreo de Monte Carlo. Otras extracciones de 100 remuestras dan lugar a valores distintos del sesgo que pueden oscilar considerablemente desde -0.01 hasta 0.1. Esto sugiere la necesidad de realizar un remuestreo con un mayor número de remuestras. Un estudio de simulación en donde se repite 100 veces el remuestreo con \(100,250,500\) y 1000 remuestras muestra el efecto del número de remuestras sobre la dispersión de las estimaciones del sesgo

15.2.4 Corrección del sesgo de un estimador

En ocasiones es deseable eliminar o reducir, dentro de lo posible, el sesgo de un estimador. Si \(\hat{\theta}=T(\mathbf{X})\) és un estimador de \(\theta\) y \(\widehat{b(T)}\) un estimador del sesgo de \(T(\mathbf{X})\), entonces una forma de reducir el sesgo de la estimación es definir el estimador corregido para el sesgo,

\[ \tilde{\theta}=T(\mathbf{X})-\widehat{b(T)} \]

El estimador del sesgo puede obtenerse por cualquier procedimiento que resulte adecuado, ya sea

- mediante una fórmula analítica “ad hoc”,

- el estimador bootstrap del sesgo, \(b_{\hat{F}}(T)\), si se sabe cómo calcularlo,

- el estimador bootstrap del sesgo aproximado por Monte Carlo \(\widehat{b_{\hat{F}}(T)}\), o

- otros métodos como el jackknife que se discutirá más adelante.

Si utilizamos el estimador bootstrap aproximado por Monte Carlo para corregir el sesgo obtenemos el estimador bootstrap de \(\theta\) corregido para el sesgo o más precisamente, el estimador de \(\theta\) corregido para el sesgo mediante bootstrap:

\[ \begin{aligned} \tilde{\theta}^{*} & =T(\mathbf{X})-\widehat{b_{\hat{F}}(T)}=T(\mathbf{X})-\left(\overline{\hat{\theta}^{*}}-T(\mathbf{X})\right)= \\ & =2 \cdot T(\mathbf{X})-\overline{\hat{\theta}^{*}} \end{aligned} \]

Este estimador no debe confundirse con la media bootstrap \(\overline{\hat{\theta}^{*}}\) que no es, en general un estimador adecuado de \(\theta\).

La corrección del sesgo no debe realizarse de forma indiscriminada. Puede darse el caso que el estimador corregido para el sesgo tenga una varianza mayor que el estimador original, con lo que el error cuadrático medio aumente en vez de disminuir. Una posibilidad, de cara a decidir si vale la pena o no corregir el sesgo es estimar el error estándar del estimador corregido para el sesgo mediante bootstrap, es decir calcular \(\widehat{\sigma_{\tilde{\theta}}^{*}}\). Si el error estándar bootstrap estimado de \(\tilde{\theta}^{*}\) y de \(\hat{\theta}^{*}\) es aproximadamente el mismo

\[ \widehat{\sigma_{\tilde{\theta}}^{*}} \approx \widehat{\sigma_{\hat{\theta}}^{*}} \]

dado que el sesgo es menor

\[ \widehat{b_{\hat{F}}\left(\tilde{\theta}^{*}\right)}<\widehat{b_{\hat{F}}\left(\hat{\theta}^{*}\right)} \]

entonces puede ser interesante, en terminos de reduccion del error cuadrático medio, la reducción del sesgo.

15.2.5 El jackknife

El jackknife fue introducido por Quenouille en 1949 para estudiar el sesgo de un estimador. Es bàsicamente un método de “remuestreo” consistente en eliminar un punto de la muestra original y recalcular el estimador. Esto da lugar a \(n\) estimaciones ligeramente distintas a partir de las cuales se estimará el sesgo.

15.2.5.1 El estimador jackknife del sesgo

Sea \(\left\{X \sim F_{\theta}, \theta \in \Theta\right\}\) y sea \(\mathbf{X}\) una muestra aleatoria simple de \(X\). La muestra jackknife \(i\)-esima, \(\mathbf{X}_{(i)}\) es:

\[ \mathbf{X}_{(i)}=\left(X_{1}, X_{2}, \ldots, X_{i-1}, X_{i+1}, \ldots, X_{n}\right) \]

es decir la muestra original de la que se ha eliminado la observación \(X_{i}\). Sea ahora \(\hat{\theta}=T_{n}(\mathbf{X})\) un estimador del parámetro \(\theta\) que puede ser, o no, un estadístico de substitución. Sea

\[ \hat{\theta}_{(i)}=T_{(n-1)}\left(\mathbf{X}_{(i)}\right)=T_{(n-1)}\left(\left(X_{1}, X_{2}, \ldots, X_{i-1}, X_{i+1}, \ldots, X_{n}\right)\right) . \]

El estimador jackknife del sesgo definido por Quenouille es:

\[ \hat{b}_{J}=(n-1)\left(\hat{\theta}_{(\cdot)}-\hat{\theta}_{n}\right), \quad \text { donde: } \hat{\theta}_{(\cdot)}=\frac{1}{n} \sum_{i=1}^{n} \hat{\theta}_{(i)} \]

A partir del estimador jackknife del seso puede definirse el estimador jackknife corregido para el sesgo:

\[ \begin{aligned} \hat{\theta}_{J}=\hat{\theta}-\hat{b}_{J} & =\hat{\theta}-(n-1)\left(\hat{\theta}_{(\cdot)}-\hat{\theta}_{n}\right) \\ & =n \hat{\theta}-(n-1) \hat{\theta}_{(\cdot)} \end{aligned} \]

A veces este estimador recibe directamente el nombre de estimador jackknife de \(\theta\). ¿Como se explica que el estimador jackknife tenga menor sesgo que el original? Supongamos que \(\hat{b}_{J}\) sea un estimador insesgado del sesgo de \(\hat{\theta}\), es decir

\[ E\left[\hat{b}_{J}\right]=b(\theta)=E\left[T_{n}\right]-\theta \]

Entonces tendremos que:

\[ \begin{aligned} b\left(\hat{\theta}_{J}\right) & =E\left[\hat{\theta}_{J}\right]-\theta=E\left[\hat{\theta}-\hat{b}_{J}\right]-\theta \\ & =E(\hat{\theta})-E\left(\hat{b}_{J}\right)-\theta= \\ & =\underbrace{\theta+b(\hat{\theta})}_{E(\hat{\theta})}-b(\hat{\theta})-\theta=0 . \end{aligned} \]

Es decir, si \(\hat{b}_{J}\) es un estimador insesgado del sesgo de \(\hat{\theta}\) entonces \(\hat{\theta}_{J}\) no tendrá sesgo:

\[ E\left(\hat{b}_{J}\right)=b(\hat{\theta}) \Longrightarrow E\left(\hat{\theta}_{J}\right)=\theta \]

Evidentemente el problema reside en que, en general, no es posible establecer analíticamente si \(\hat{b}_{J}\) esta centrado, o no, en el sesgo de \(\hat{\theta}, b(\theta)\). Efron ([7]) da un argumento heurístico, no del todo formal, para argumentar que, como mínimo, el sesgo de \(\hat{\theta}_{J}\) suele ser inferior al de \(\hat{\theta}\). Para ello se basa en el hecho de que muchos estimadores sesgados son asintóticamente insesgados dado que, a menudo el sesgo es una función del tamaño muestral que tiende a 0 cuando \(n \longrightarrow \infty\), es decir

\[ b(\hat{\theta})=o(1) \]

Ejemplos conocidos de esta propiedad son la variancia muestral o el máximo de una muestra en una distribución uniforme \(\mathcal{U}(0, \theta)\). Para los estimadores de este tipu suele exisatir un desarrollo asintótico de la esperanza en potencias de \(n\), del tipo:

\[ E(\hat{\theta})=\theta+\frac{a_{1}}{n}+\frac{a_{2}}{n^{2}}+\frac{a_{3}}{n^{3}}+\ldots, \]

donde las \(a_{i}\) dependen únicamente de \(F\) pero no de \(n, a_{i}=a_{i}(F)\), de forma que podemos poner el sesgo de \(\hat{\theta}\) como

\[ b(\hat{\theta})=E(\hat{\theta})-\theta=\frac{a_{1}}{n}+\frac{a_{2}}{n^{2}}+O\left(\frac{1}{n^{3}}\right) \]

Suponiendo que el desarrollo (2.7) exista entonces podemos justificar que el sesgo de \(\hat{\theta}_{J}\) es inferior al de \(\hat{\theta}\). Veamos como. Si suponemos que

\[ b(\hat{\theta})=\frac{a_{1}}{n}+\frac{a_{2}}{n^{2}}+O\left(\frac{1}{n^{3}}\right) \]

entonces

\[ b\left(\hat{\theta}_{(i)}\right)=\frac{a_{1}}{n-1}+\frac{a_{2}}{(n-1)^{2}}+O\left(\frac{1}{(n-1)^{3}}\right) \]

y por lo tanto, dado que

\[ E\left[\hat{\theta}_{(\cdot)}\right]=E\left(\frac{1}{n} \sum_{i=1}^{n} \hat{\theta}_{(i)}\right)=E\left(\hat{\theta}_{(i)}\right) \]

el sesgo de \(\hat{\theta}_{(\cdot)}\) tiene la misma expresión que el de \(\hat{\theta}_{(i)}\). Podemos calcular la esperanza del estimador del sesgo, es decir:

\[ \begin{aligned} E\left(\hat{b}_{J}\right) & =E\left[(n-1)\left(\hat{\theta}_{(\cdot)}-\hat{\theta}_{n}\right)\right] \\ & =(n-1)\left(E\left(\hat{\theta}_{(\cdot)}\right)-E\left(\hat{\theta}_{n}\right)\right) \\ & =(n-1)\left[\left(\theta+b\left(\hat{\theta}_{(i)}\right)\right)+\left(\theta+b\left(\hat{\theta}_{n}\right)\right)\right] \\ & =(n-1)\left[b\left(\hat{\theta}_{(i)}\right)-b\left(\hat{\theta}_{n}\right]\right. \\ & =(n-1)\left[\left(\frac{1}{n-1}-\frac{1}{n}\right) a_{1}+\left(\frac{1}{(n-1)^{2}}-\frac{1}{n^{2}}\right) a_{2}+O\left(\frac{1}{n^{3}}\right)\right] \\ & =\frac{a_{1}}{n}+\frac{(2 n-1)}{n^{2}(n-1)} a_{2}+O\left(\frac{1}{n^{2}}\right) \end{aligned} \]

La expresion anterior muestra que, bajo determinadas suposiciones, \(\hat{b}_{J}\) es correcto hasta el orden \(n^{-2}\) com estimador del sesgo de \(\hat{\theta}_{n}\).

Reuniendo lo anterior para determinar el sesgo de \(\hat{\theta}_{J}\) tendremos:

\[ \begin{aligned} b\left(\hat{\theta}_{J}\right) & =b\left(\hat{\theta}_{n}-\hat{b}_{J}\right)= \\ & =b\left(\hat{\theta}_{n}\right)-E\left(\hat{b}_{J}\right)= \\ & =-\frac{b}{n(n-1)}+O\left(\frac{1}{n^{2}}\right) \end{aligned} \]

que es de un orden inferior a \(b\left(\hat{\theta}_{n}\right)\), lo que explica porqué, en general, \(\hat{\theta}_{J}\) tendrá menos sesgo que \(\hat{\theta}_{n}\).

Aún insistiendo en el hecho de que la aproximación que hemos realizado es heurística su validez es bastante grande. Por ejemplo para los estimadores máximo verosímiles suele existir un desarrollo asintótico de la esperanza con lo que en este caso la afirmación seria cierto.

15.2.6 Ejercicios

- Supongamos que utilizamos la mediana muestral para estimar la media poblacional \(\theta=E_{F}(X)\). Describa el estimador bootstrap del sesgo \(\widehat{\operatorname{bias}}_{B}\).

- Sea \(\widehat{b i a s}_{\text {JACK }}\) el estimador jackknife del sesgo de un estimador \(\hat{\theta}\) :

\[ \widehat{\operatorname{bias}}_{J A C K}=(n-1)\left(\hat{\theta}_{(\cdot)}-\hat{\theta}\right), \]

siendo

\[ \begin{array}{r} \hat{\theta}_{(\cdot)}=\sum_{i=1}^{n} \hat{\theta}_{(i)} / n, \mathrm{y} \\ \hat{\theta}_{(i)}=\hat{\theta}\left(x_{1}, x_{2}, \ldots, x_{i-1}, x_{i+1}, \ldots x_{n}\right) \end{array} \]

Mostrar que, si \(\hat{\theta}=\bar{x}\) entonces \(\hat{\theta}_{(\cdot)}-\hat{\theta}=0\), es decir \(\widehat{\operatorname{bias}}_{\text {JACK }}=0\). 3. Demuestre que si \(\hat{\theta}=\bar{x}\) el estimador jackknife del error estandar definido por

\[ \widehat{E E}_{J A C K}=\sqrt{\frac{n-1}{n} \sum_{i=1}^{n}\left(\hat{\theta}_{(i)}-\hat{\theta}_{(\cdot)}\right)^{2}} \]

coincide con el estimador insesgado del error error estándar de la media

\[ \hat{s} / \sqrt{n}=\sqrt{\sum_{i=1}^{n}\left(x_{i}-\bar{x}\right)^{2} /\{(n-1) n\}} . \]

15.3 Intervalos de confianza bootstrap

15.3.1 Introducción

Como hemos visto en el apartado anterior, un aspecto importante en la estimación de un parámetro es el grado de precisión de dicha estimación. Una forma de incluir la medida de la precisión en la estimación consiste en utilizar estimadores por intervalo, es decir, estimar \(\theta\) mediante un subconjunto \(T \subset \Theta\) del espacio paramétrico que verifique:

\[ T=\{t \in \Theta \mid P(\theta \in T)=(1-\alpha)\} . \]

Hay muchos métodos para construir intervalos de confianza (IC de aquí en adelante). Bajo ciertas circunstancias es posible obtener IC exactos, entendiendo como tales aquellos en que el recubrimiento real del intervalo, \(P(\theta \in T)\) es igual al recubrimiento nominal \(1-\alpha\) con que se pretende estimar el parámetro.

El método del pivote o el de Neyman, que se estudian en los cursos introductorios de Estadística Matemática, pueden dar IC exactos en algunos casos, como la media de una población normal o el parámetro de una ley exponencial. Son sin embargo escasas las ocasiones en que se verifican las condiciones de aplicación de estos métodos. En muchas situaciones de interés es preciso recurrir a intervalos de confianza aproximados en los que el recubrimiento real es tan solo aproximadamente igual al nominal es decir \(P(\theta \in T) \simeq 1-\alpha\).

El bootstrap se ha revelado como una técnica de gran utilidad de cara a construir IC aproximados. Como hemos visto en la primera parte de este tema su naturaleza esencialmente no paramétrica permite abordar gran tipo de situaciones en los que las condiciones de aplicación de otros métodos “clásicos” no se verifican.

Una ventaja adicional de los métodos bootstrap es que, mediante procedimientos sofisticados, en los que aquí no entraremos, es posible conocer qué tan bueno es el grado de aproximación de un IC aproximado, valga la redundancia. Dicho de otra forma, se puede cuantificar la diferencia entre el recubrimiento real y el nominal. Ello ha permitido no tan sólo crear una amplia gama de metodos de construcción de IC sino también determinar en qué grado la estimación que estos ofrecen debe de considerarse aceptable.

El número de técnicas que se basan en la distribución bootstrap del estadístico para, en una forma u otra, obtener intervalos de confianza es muy elevado. Para evitar que, como se suele decir, el gran número de árboles no nos impida ver el bosque, nos centraremos en tres categorías: los intervalos de confianza estándar, los intervalos de confianza estudentizados o bootstrap-t y el grupo de los denominados métodos percentil, todos ellos ideados por Efron que fue introduciendo sofisticaciones en una interesante idea inicial.

15.3.2 Intervalos de confianza estándar

El concepto de IC estándar no va necesariamente ligado al bootstrap . La idea en que se basa consiste en suponer que, dado un parámetro \(\theta\), un estimador centrado \(\hat{\theta}\) de \(\theta\) y el error estándar de \(\hat{\theta}, \sigma_{\hat{\theta}}\),se verifica de forma aproximada que:

\[ \frac{\hat{\theta}-\theta}{\sigma_{\hat{\theta}}} \xrightarrow{\mathcal{L}} N(0,1) . \]

Bajo esta suposición un IC aproximado al nivel de confianza \((1-\alpha)\) será:

\[ \hat{\theta}-z_{1-\alpha / 2} \sigma_{\hat{\theta}}, \hat{\theta}-z_{\alpha / 2} \sigma_{\hat{\theta}} \]

donde \(z_{1-\alpha / 2}\) es el percentil \(100(1-\alpha / 2)\) de la distribución normal \(N(0,1)\). En una situación paramétrica, \(\sigma_{\hat{\theta}}\) puede ser el error estándar asintótico del estimador máximo-verosímil o incluso una expresión exacta. P.ej. si \(\hat{\theta}=\hat{\rho}\), el coeficiente de correlación muestral, entonces, supuesta la distribución de la población normal bivariante, podemos usar el estimador de la teoría normal:

\[ \sigma_{N O R M}=\left(1-\rho^{2}\right) /(n-3)^{1 / 2} \]

Cuando no se conoce la forma de \(\sigma_{\hat{\theta}}\) puede utilizarse el estimador bootstrap del error estándar, \(\sigma_{B O O T}\) definido en la sección anterior, que, como hemos visto puede siempre aproximarse mediante el algoritmo de Monte Carlo.

Los IC estándar resultan muy atractivos -han sido y son muy utilizados en la práctica- por el hecho de ser automáticos: es posible escribir un programa que a partir de cualquier conjunto de datos estime el parámetro y los construya.

Su inconveniente principal reside en el hecho de que son aproximados, con lo pueden dar lugar a intervalos inexactos. Vale la pena destacar que, de hecho, suelen ser doblemente aproximados puesto que en la práctica se realizan a menudo no una sino dos aproximaciones:

- La suposición de normalidad, que no es necesariamente cierta, sobre todo en muestras pequeñas,

- A menudo el error estándar es funcion del parámetro desconocido, es decir \(\sigma_{\hat{\theta}}=\sigma_{\hat{\theta}}(\theta)\) con lo que no podemos basarnos en la aproximación

\[ \frac{\hat{\theta}-\theta}{\sigma_{\hat{\theta}}} \xrightarrow{\mathcal{L}} N(0,1), \]

sinó en esta otra, de velocidad de convergencia más lenta, y por lo tanto más errónea en muestras pequeñas:

\[ \frac{\hat{\theta}-\theta}{\hat{\sigma}_{\hat{\theta}}} \xrightarrow{\mathcal{L}} N(0,1) . \]

Un ejemplo conocido de esta doble aproximación es el caso de la proporción muestral que estima la probabilidad de observar un suceso \(A, P(A)\) mediante

\[ \hat{p}=\frac{\sum_{i=1}^{n} Y_{i}}{n}, Y=\left\{\begin{array}{l} 1, \text { si se presenta un suceso } A \\ 0, \text { si no se presenta el suceso } \end{array}\right. \]

donde el error estándar de \(\hat{p}\) es:

\[ \sigma_{\hat{p}}=\sqrt{\frac{p \cdot q}{n}}, \]

que debe aproximarse en la práctica por:

\[ \hat{\sigma}_{\hat{p}}=\sqrt{\frac{\hat{p} \cdot \hat{q}}{n}} \]

Otros ejemplos de sta doble aproximación los tendremos cuando utilicemos el estimador aproximado por montecarlo del estimador bootstrap del error estándar o el estimador del error estándar del coeficiente de correlación,(3.1), en donde substituyamos \(\rho\) por su estimador máximo verosímil, \(\hat{\rho}\).

15.4 Intervalos de confianza basados en tablas bootstrap

15.4.1 El caso de la t de Student

Cuando el parámetro de interés es la media poblacional de una distribución normal \(X \sim N(\mu, \sigma)\), que estimamos mediante la media muestral, \(\hat{\theta}=\bar{X}\), existe una solución conocida para que no sea preciso realizar la doble aproximación

\[ \frac{\bar{X}-\mu}{\hat{\sigma}_{\bar{X}}} \dot{\sim} N(0,1) \]

Tomando \(\hat{\sigma}_{\bar{X}}=s / \sqrt{n-1}\), donde \(s\) representa la desviación típica muestra, és decir el estimador maximo verosímil de \(\sigma\), la distribución del estadístico anterior es una \(t\) de Student con \(n-1\) grados de libertad, es decir:

\[ \frac{\bar{X}-\mu}{s / \sqrt{n-1}} \sim t_{n-1} \]

Basándonos en esta aproximación el intervalo de confianza que se obtiene para \(\hat{\theta}\) es:

\[ \hat{\theta}-t_{n-1,1-\alpha / 2} \hat{\sigma}_{\hat{\theta}}, \hat{\theta}-t_{n-1, \alpha / 2} \hat{\sigma}_{\hat{\theta}} \]

donde \(t_{n-1,1-\alpha / 2}\) es el percentil \(1-\alpha / 2\) de la distribución \(t\) de Student con \(n-1\) grados de libertad.

Este intervalo es exacto si \(X \sim N(\mu, \sigma)\) y el parámetro a estimar es la media, \(\mu \mathrm{y}\) tiene el efcto de ensanchar el intervalo para compensar el error cometido al tener que estimar \(\sigma_{\bar{X}}\), con \(\hat{\sigma}_{\bar{X}}\). Esto se debe al hecho de que la distribución \(t\) de Student es ligeramente más ancha que la \(N(0,1)\) a la cual tiende cuando \(n \rightarrow \infty\).

Si, por ejemplo tomamos los datos de tiempos de supervivencia de los ratones del grupo control, discutidos en el capítulo 1

\[ 52,10,40,104,51,27,146,30,46 \]

con media y error estándar

\[ \bar{X}=56,22, \hat{\sigma}_{\bar{X}}=s / \sqrt{n-1}=13,33 \]

obtenemos el intérvalo de confianza “aproximadísimo” al \(95 \%\) basado en la normal:

\[ 56,22 \pm 1,645 \times 13,33=[34,29,78,15] \]

y el intervalo de confianza basado en la \(t\) de tudent:

\[ 56,22 \pm 1,86 \times 13,33=[31,22,81,01] . \]

La corrección que efectua el segundo tipo de intérvalo es válida únicamente para la media. Otros estadísticos como la mediana no pueden aprovecharla por lo que un intervalo de confianza estándar para la mediana seria del tipo:

\[ \widehat{M e d} \pm 1,645 \times \hat{\sigma}_{B O O T}(\widehat{M e d}) . \]

15.4.2 Intervalos de confianza basados en tablas bootstrap

Hasta el momento hemos podido constatar que la aproximación normal falla, especialmente con muestras pequeñas si tenemos que estimar \(\sigma_{\hat{\theta}}\).

Tambien hemos visto un caso, la media muestral en que este problema se compensa utilizando unas tablas diferentes a las de la \(N(0,1)\), las de la \(t\) de Student. Observamos que lo que ha sucedido es que hemos ganado en precisión al precio de perder generalidad ya que hemos pasado de usar unas tablas válidas para todas las muestras a necesitar una distinta para cada tamaño muestral. Encima esta mejora con “coste” solo es válida para el caso de la media muestral. Para la inmensa mayoria de los estadísticos restantes no es válida.

El bootstrap-t fuerza esta idea de ganar precisión perdiendo generalidad y pasa de tener una tabla distinta para cada tamaño muestral a tener una tabla distinta para cada muestra. Es decir lo que hace este procedimiento es construir una tabla a medida para cada muestra. Esta tabla se utilizará para construir intervalos de confianza exactament de la misma forma en que se procedia con la \(N(0,1)\) o con la \(t_{n-1}\).

El algoritmo para el cálculo de los intervalos de confianza es el siguiente:

- Sea \(\mathbf{X}\) la muestra original y \(\hat{\theta}=T(\mathbf{X})\)

- Extraer \(B\) muestras, \(\mathbf{X}_{1}^{*}, \mathbf{X}_{2}^{*}, \ldots, \mathbf{X}_{B}^{*}\) de \(F_{n}\)

- Sobre cada una de ellas:

- Calcular \(\hat{\theta}_{b}^{*}=T\left(\mathbf{X}_{b}^{*}\right), \widehat{\sigma}_{\hat{\theta}}\left(\mathbf{X}_{b}^{*}\right)=\widehat{\sigma}_{b}^{*}\)

- Calcular

\[ \frac{\hat{\theta}_{b}^{*}-\hat{\theta}}{\widehat{\sigma}_{b}^{*}}=z_{b}^{*} \]

Este algoritmo dara lugar a \(B\) valores \(z_{1}^{*}, z_{2}^{*}, \ldots, z_{B}^{*}\) que, una vez ordenados \(z_{(1)}^{*}, z_{(2)}^{*}, \ldots, z_{(B)}^{*}\) representan la aproximación de Monte carlo a la distribución bootstrap del estadístico

\[ Z=\frac{\hat{\theta}-\theta}{\widehat{\sigma}_{\hat{\theta}}} \]

- El percentil \(\alpha\) de de \(\mathrm{Z}^{*}\) lo estimaremos por el valor \(\hat{t}^{(\alpha)}\) que verifica que

\[ \frac{\#\left\{z_{b}^{*} \leq \hat{t}^{(\alpha)}\right\}}{B}=\alpha, \]

- El intervalo de confianza basado en el bootstrap- \(t\) será finalmente:

\[ \hat{\theta}-\hat{t}^{(1-\alpha / 2)} \hat{\sigma}_{\hat{\theta}}, \hat{\theta}-\hat{t}^{(\alpha / 2)} \hat{\sigma}_{\hat{\theta}} . \]

Aplicando este método a la media del grupo control se obtiene

\[ 56,22-1,53 \times 13,33,56,22+4,53 \times 13,33=[35,82,116,74] . \]

Si comparamos los tres intervalos desarrollados hastra el momento observamos lo siguiente:

| Intervalo | Extremos |

|---|---|

| Normal | \([34,29,78,15]\) |

| \(t\) de Student | \([31,22,81,01]\) |

| Bootstrap- \(t\) | \([35,8,116,7]\). |

Pdemos observar que, mientras el extremo inferior és muy parecido en los tres casos el IC basado en el bootstrap tiene un extremo superior más alargado, como consecuencia de que en 1 muestra aparecen 2 valores muy grandes.

El estadístico \(Z=\frac{\hat{\theta}-\theta}{\widehat{\sigma}_{\hat{\theta}}}\), cuya distribución aproximamos doblemente mediante bootstrap recibe el nombre de pivote aproximado, lo que da a entender que su distribución no depende de \(\theta\). Esta propiedad es la que permite utilizarlo para construir el intervalo de confianza basado en el bootstrap-t.

La clave del buen funcionamiento del bootsrap- \(t\) está precisamente en qué tan buena aproximación a la distribución del pivote podemos lograr mediante el remuestreo. Estudios teóricos bastante complejos demuestran que, en muestras grandes el recubrimiento del bootstrap-t tiende a aproximarse más al recubrimiento nominal, es decir el recubrimiento que se desea que tengan los intervalos de confianza en el momento de construirlos, que los intervalos estándar o basados en la \(t\) de Student. El bootstrap- \(t\) es una generalización de la \(t\) de Student que extiende su aplicabilidad de la media muestral a estadísticos de posición como la media, la mediana, la media recortada o el percentil de la muestra.

Resumiendo:

| Intervalos | IC estándar (Normales) |

IC estandar (t de Student) |

Bootstrap-t |

|---|---|---|---|

| Propiedades | Simétricos | Simétricos | No simétricos |

| Tablas | Muy inexactos | Poca exactitud | Los más exactos |

| Una sola | Una para cada \(n\) | Una por muestra |

15.4.3 El bootstrap-t y las transformaciones

A pesar de sus buenas propiedades el bootstrap- \(t\) no es la “panacea” en cuanto a intervalos de confianza, puesto que presenta algunas dificultades.

- El cálculo de los intervalos basados en el bootstrap-t puede ser muy costoso computacionalmente. Como hemos visto se basa en calcular o aproximar los percentiles de \(Z_{b}^{*}\) definido como

\[ Z_{b}^{*}=\frac{\hat{\theta}_{b}^{*}-\hat{\theta}}{\widehat{\sigma}_{b}^{*}}=\frac{T\left(\mathbf{X}_{b}^{*}\right)-T(\mathbf{X})}{\widehat{\sigma}_{\hat{\theta}}\left(\mathbf{X}_{b}^{*}\right)} \]

pero, dado que, en general, no se dispone de una fórmula cerrada con la que calcular \(\widehat{\sigma}_{\hat{\theta}}\left(\mathbf{X}_{b}^{*}\right)\) suele recurrirse de nuevo al bootstrap (una alternativa es el jackknife) es decir debemos remuestrear cada remuestra para estimar el error estándar, lo que conlleva de nuevo un error de aproximación:

\[ \widehat{\sigma}_{b}^{*} \approx \widehat{\sigma}_{b, B_{2}}^{* *} \]

Teniendo en cuenta que para construir intervalos de confianza suelen considerarse necesarias unas \(1000-2000\) remuestras, si cada una tiene que remuestrearse entre 100 y 200 veces estamos hablando de un número total de remuestras que oscila entre 100.000 y 400.000 , lo que, segun para que modelos puede resultar bastante costoso.

- Para que el bootstrap-t funcione correctamente el estimador del error estándar debe ser estable, es decir no debe tener una gran variación entre muestras. Algunos estimadores del error estándar varian mucho entre muestras, y, en estos casos el bootstrap- \(t\) puede dar resultados erráticos. Para acabar de empeorar la situación el estimador bootstrap del error estándar no es estable, es decir no tan sólo da lugar a que el proceso sea costoso sino que puede hacer que no sea bueno.

Un caso conocido, en donde el bootstrap- \(t\) no funciona correctamente es el coeficiente de correlación. Si aplicamos sin más el bootsrap- \(t\) a los datos de las notas de los 15 alumnos presentados en el capítulo 1 , tomando \(B_{1}=1000\), \(B_{2}=25\) y \(\alpha=0.10\) obtenemos

\[ \left[\hat{\rho}_{i n f}, \hat{\rho}_{s u p}\right]=[-0,026,0,90] \]

que, para un valor de \(\hat{\rho}\) de 0.776 parece excesivamente ancho (Un test basado en estos intervalos nos llevaria a considerar no significativa la correlación entre ambas notas, lo cual contradice la intuición de los datos).

15.4.3.1 Transformación normalizante para el coeficiente de correlación

Los textos de estadística matemática sugieren que para hacer inferencia sobre el coeficiente de correlación, si los datos siguen una distribución normal bivariante puede aplicarse lo que se conoce con el nombre de transformación normalizante de Fisher para el coeficiente de correlación. Ésta permite normalizar el coeficiente de correlación muestral, \(\hat{\rho}\) aplicándole la transformación arco tangente hiperbólica, \(\tanh ^{-1}\). Dado que se trata de una transformación monótona ello permite la construcción de intervalos de confianza por el procedimiento siguiente:

- Dado \(\hat{\rho}\) el coeficiente de correlación calculado sobre una muestra la transformación \(\tanh ^{-1}(\hat{\rho})\) da lugar a un estadístico aproximadamente normal:

\[ \tanh ^{-1}(\hat{\rho})=\hat{\phi} \simeq N\left(\mu_{\phi}, \sigma_{\phi}\right), \quad \mu_{\phi}=\phi+\frac{\rho}{2(n-1)}, \quad \sigma_{\phi}=\frac{1}{(n-3)} \]

- A continuación se construye un intervalo de confianza “normal” para \(\phi\)

\[ \left[\hat{\phi}_{1}, \hat{\phi}_{2}\right], \quad \hat{\phi}_{1}=\mu_{\hat{\phi}}-z_{\alpha / 2} \sigma_{\hat{\phi}}, \hat{\phi}_{2}=\mu_{\hat{\phi}}+z_{\alpha / 2} \sigma_{\hat{\phi}} \]

- Invirtiendo la transformación se obtienen intervalos de confianza para \(\rho\).

\[ \begin{aligned} & \hat{\rho}_{1}=\tanh \left[\left(\phi+\frac{\hat{\rho}}{2(n-1)}\right)-\frac{z_{\alpha / 2}}{\sqrt{n-3}}\right] \\ & \hat{\rho}_{2}=\tanh \left[\left(\phi+\frac{\hat{\rho}}{2(n-1)}\right)+\frac{z_{\alpha / 2}}{\sqrt{n-3}}\right] . \end{aligned} \]

Por ejemplo, con los datos de las notas de 15 alumnos si

- \(\alpha=0,05\) el intervalo de confianza obtenido es [0,592, 0,926]

- \(\alpha=0,10\) el intervalo de confianza obtenido es \([0,4487,0,9495]\).

15.4.3.2 Aplicación del bootstrap- \(t\) sobre la escala transformada

La idea de transformar los datos para construir los intervalos de confianza puede expresarse, esquemáticamente:

\[ \hat{\rho} \xrightarrow{\text { tanh }} \hat{\phi}^{\text {IC estandar }}\left[\hat{\phi}_{1}, \hat{\phi}_{2}\right] \xrightarrow{\text { tanh }^{-1}}\left[\hat{\rho}_{1}, \hat{\rho}_{2}\right] \quad(\stackrel{\alpha=0,10}{=}[0,4487,0,9495]) \]

Si procedemos de forma similar pero una vez en la escala transformada calculamos intervalos de confianza basados en el bootstrap- \(t\)

\[ \hat{\rho} \xrightarrow{\text { tanh }} \hat{\phi} \xrightarrow{\text { Bootstrap- } t}\left[\hat{\phi}_{1}^{*}, \hat{\phi}_{2}^{*}\right] \xrightarrow{\tanh ^{-1}}\left[\hat{\rho}_{1}^{*}, \hat{\rho}_{2}^{*}\right] \quad(\stackrel{\alpha=0,10}{=}[0,45,0,93]) \]

obtenemos unos intervalos distintos, aparentemente mejores, que los que obteníamos para el coeficiente de correlación al trabajar sobre la escala sin transformar. Si el coeficiente de confianza es menor la diferencia resulta aún más exagerada. Un intervalo bootstrap- \(t\) al \(98 \%\) es \([-0.66,1.03]\) en la escala original y [0.17,0-95] en la transformada.

Resumiendo: El bootstrap-t no da lugar a intervalos que se conserven al transformar los datos. En el ejemplo anterior los mejores intervalos son los construidos en la escala transformada ( \(\hat{\phi}\) ) puesto que sabemos que la transformación es realmente normalizante. De hecho si calculamos los intervalos de confianza estándar a partir de \(\hat{\phi}\) y los invertimos obtenemos valores similares a los obtenidos con el bootstrap- \(t\) basado calculado sobre \(\hat{\phi}\) e invirtiendo.

| \(90 \%\) | \(98 \%\) | |||

|---|---|---|---|---|

| Ext. inf | Ext. sup | Ext. inf | Ext. sup. | |

| bootstrap-t directo | -0.026 | 0.90 | -0.66 | 1.03 |

| bootstrap-t para \(\hat{\phi}\) e inversión | 0.45 | 0.903 | 0.17 | 0.95 |

| IC estándar para \(\hat{\phi}\) e inversión | 0.591 | 0.926 | 0.449 | 0.949 |

El bootsrap- \(t\) funciona “tan bien como lo correcto” es decir el intervalo estándar en la escala normal, cuando se conoce la transformación normalizante.

En general no conoceremos esta transformación y tendremos que considerar distintas alternativas:

- Suponer que existe aunque no la conozcamos. Esto nos llevará a los métodos percentil desarrollados por Efron

- Estimar la transformación utilizando el bootstrap.

15.5 Intervalos de confianza basados en percentiles bootstrap

15.5.1 Intervalos basados en percentiles de una distribución normal

Los métodos percentil fueron ideados por Efron entre 1979 y 1987 ([7, 9, 10, 11]) quien en sucesivos trabajos fue refinando la idea original en que se basan.